WAN2.2のT2Vモデルで画像生成 – Fluxの「プラスチック肌」問題を解決!

WAN2.2のT2V(Text-to-Video)モデルを使って画像生成を試してみたところ、驚くべき結果が得られました。なんと、Fluxモデルで問題となっていた肌のプラスチック感を完全に解消できたのです!

RTX5090での検証結果、効果は特に素晴らしいものでした!

使用モデル

wan2.2_t2v_low_noise_14B_fp16.safetensors

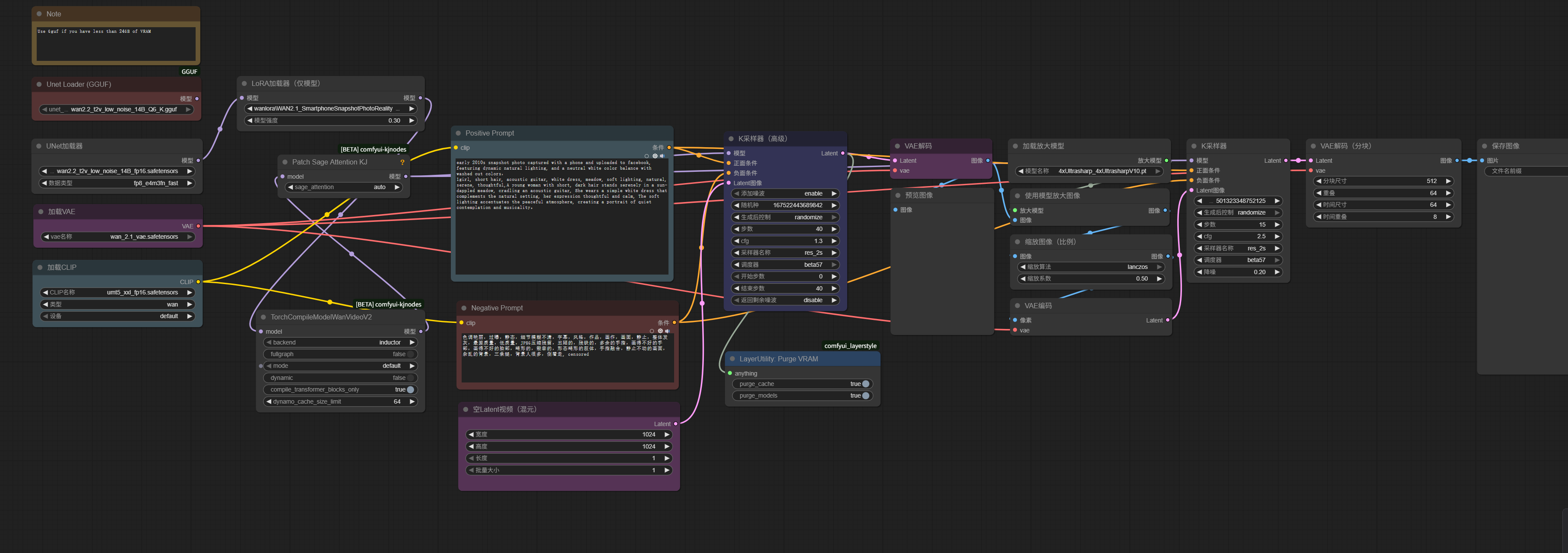

使用ノード構成

- KJの高速化ノード

- アップスケールノード

生成速度

処理時間の内訳は以下の通りです:

処理段階設定所要時間

基本生成40ステップ約60秒

アップスケール2048×204890秒

合計処理時間-150秒

Fluxとの比較優位性

従来のFluxモデルでは、特に人物の肌質表現において「プラスチックのような不自然な質感」が課題となっていました。しかし、WAN2.2のT2Vモデルを使用することで:

- 自然な肌質の表現が可能

- リアルな質感の実現

- より人間らしい仕上がり

これらの改善により、画像生成の品質が大幅に向上しました。

ワークフローのダウンロード

https://drive.google.com/file/d/102b0Lw9JJ80J8xVnNY08e5d2OMhvPYwX/view?usp=sharing

まとめ

WAN2.2のT2Vモデルは、従来のFluxモデルの弱点を克服した画期的なモデルです。RTX5090との組み合わせにより、高品質な画像を短時間で生成できる実用的なソリューションとなっています。

特に人物画像の生成において、自然な肌質表現を求めるクリエイターにとって、このモデルは非常に価値のあるツールになるでしょう。

総処理時間150秒で高品質な2048×2048の画像が生成できる効率性も、実用面での大きなメリットです。