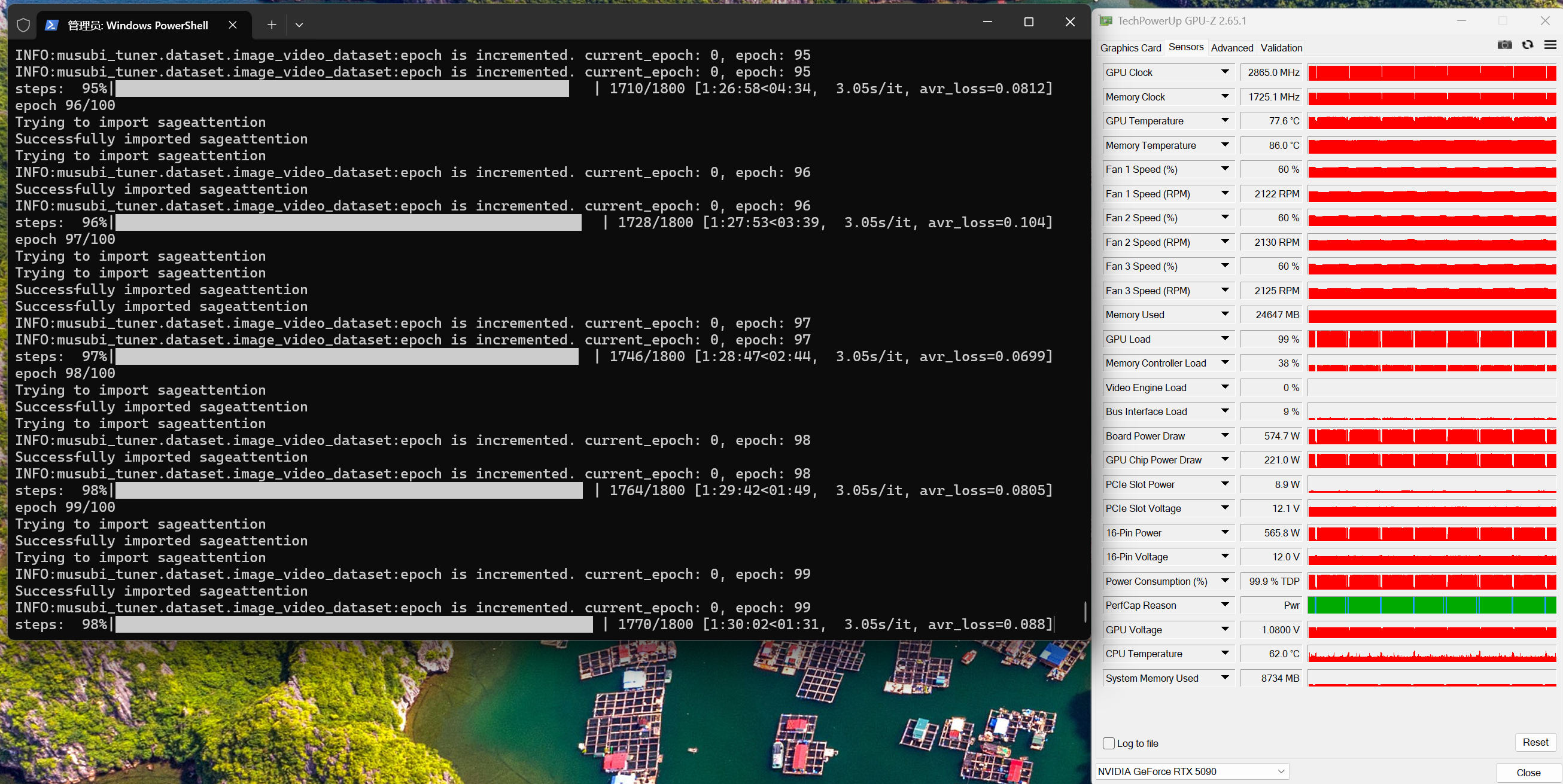

はじめに Comfyuiで、LoRAモデルの重要性はますます高まっています。特にFluxモデルでのLoRAトレーニングは、個性的なキャラクターや独特なアーティスティックスタイルを再現するために欠かせない技術となっています。 私は自宅にRTX 5090を所有していますが、LoRAモデルのトレーニングにおいてGoogle Colabを選択している理由があります。RTX 5090は間違いなく強力なGPUですが、消費電力が非常に高く、長時間のトレーニングセッションでは電気代が気になります。さらに、数時間連続で動作させると発熱も相当なものになり、負荷が心配になります。 そこで、Google ColabのA100 GPUを活用することで、これらの問題を解決しながら効率的にLoRAモデルをトレーニングする方法をご紹介します。 Ⅰ:写真選択 数量15ー50 キャラクターLoRAの場合 キャラクターLoRAを作成する際の写真選択は、最終的な品質を決定する最も重要な要素の一つです。以下の基準を厳密に守ることで、原人物に非常に近いLoRAモデルを作成できます。 背景除去の重要性 まず、すべての写真から背景を完全に除去し、人物のみを残すことが重要です。背景が残っていると、モデルが人物の特徴ではなく背景の要素を学習してしまう可能性があります。この作業は手間がかかりますが、最終的な品質に大きく影響するため妥協できません。 comfyuiで背景を除去方法: https://shiokoto.com/archives/72 解像度とサイズの最適化 写真の解像度は可能な限り高品質を維持し、理想的には1024×1024ピクセルのサイズに統一します。これより小さいサイズでも訓練は可能ですが、あまりに小さすぎたりぼやけた写真は避けるべきです。解像度が低い写真を使用すると、生成される画像の品質も低下してしまいます。 多角度撮影の重要性...